科技领域近日迎来一则备受瞩目的消息:特斯拉与SpaceX创始人埃隆·马斯克,在社交平台X上对一家中国AI公司月之暗面的技术成果公开点赞,称其“做出了令人印象深刻的结果”。这一表态在AI圈引发广泛关注,毕竟马斯克向来以在AI领域观点犀利、要求严苛著称,此前没少批评Anthropic和OpenAI,甚至曾直言Anthropic的图标设计不妥。

马斯克此次点赞的并非模型,而是月之暗面团队提出的一种全新架构改进方式。现代大语言模型,无论是GPT、Claude,还是国内的豆包、DeepSeek,以及月之暗面自家的K2.5,底层架构都基于Transformer。而Transformer能训练到几十层甚至上百层不崩溃,得益于“残差连接”机制。该机制由何恺明在2015年参与的ResNet论文提出,后被Transformer沿用。其原理是每一层网络计算后,将输出与输入相加传至下一层,如此梯度在反向传播时可直达底层,避免因层数过深而消失。

然而,这种“加法”存在一定问题。不同层输出的信息在最终隐藏状态中权重相同,随着层数增加,早期层信息被稀释,后面层需输出更大数值才能产生影响,进而加剧不稳定性,这一现象被称为“PreNorm稀释”。月之暗面团队发现,这一问题与早年RNN面临的困境有结构上的对称性。RNN在时间维度上做固定权重累加,长距离依赖难以捕捉,Transformer用注意力机制替代其线性累加,解决了该问题。但在深度维度上,同样的问题却一直未得到解决。

月之暗面团队认为,标准残差连接本质是“深度维度上的线性注意力”,他们计划将其升级为“深度维度上的softmax注意力”,并提出了“理想版”方案——全注意力残差。具体做法是给每一层赋予可学习的查询向量,对之前所有层输出做注意力计算,产生归一化权重,当前层输入按此权重加权组合,不同token经过同一层时可从不同历史层提取信息。但这一方案在大规模训练时存在内存和通信开销过大的问题,因为需要存储和传递所有层输出。

为解决这一问题,团队又提出块注意力残差方案。他们将所有层分成若干块,块内用传统残差连接求和,块间用注意力机制选择性聚合。这样只需存储和传输每个块的汇总表示,内存占用大幅降低。在此基础上,团队还进行了一系列工程优化,如跨阶段缓存消除流水线并行中的冗余传输,两阶段推理策略分摊跨块注意力计算。最终,注意力残差作为标准残差连接的替代品,训练额外开销小,推理延迟增加不到2%。

团队通过两个实验验证这一改进的效果。在scaling law实验中,结果显示注意力在所有计算预算下都优于基线,效果相当于用1.25倍计算量训练出的基线模型。在实战验证中,团队用480亿参数的大模型,用超一万亿个词的数据进行完整预训练,在科学问答、数学推理、代码生成、综合知识等测试中,加了块注意力残差的版本全面超越未加的版本。训练动态分析也表明,块注意力残差缓解了PreNorm稀释问题,各层输出幅度稳定,梯度分布均匀。

论文还通过统一的结构化矩阵分析证明,标准残差连接及其变体本质都是深度维度上线性注意力的特例。自2015年ResNet以来,残差连接板块无实质性变化,而月之暗面的这篇论文是首个既有理论依据,又能大规模实际部署且低成本的方案,这也是马斯克点赞的原因。

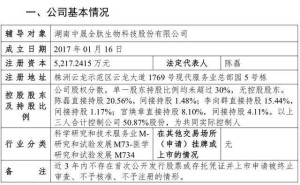

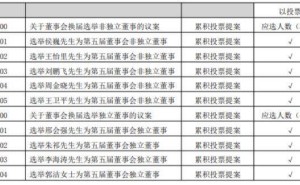

月之暗面目前正处于上市前的关键阶段,融资进展顺利。2025年12月底完成5亿美元C轮融资,投后估值43亿美元;两个月后完成超7亿美元C+轮融资,投后估值突破100亿美元;3月中最新投前估值上升至180亿美元,新一轮10亿美元融资正在推进,3个月内估值增长超4倍。其Kimi K2.5模型发布不到一个月,累计收入就超过2025年全年总收入,个人订阅用户支付订单数在1月环比增长8280%,2月又环比增长123.8%,进入Stripe全球榜单前十。

不过,月之暗面也面临一些争议。几天前,OpenClaw创始人彼得·斯坦伯格公开质疑月之暗面的Kimi Claw产品。月之暗面此前推出OpenClaw的云端一键部署服务Kimi Claw,其逻辑与OpenClaw“本地优先”的设计理念相悖。OpenClaw的agent运行在用户设备上,数据不经过第三方,大模型仅提供操作指令。而Kimi Claw将数据搬到云端服务器,在安全和隐私层面风险不同。斯坦伯格的质疑在社区产生实际影响,最初询问的用户表示鉴于安全性问题,暂时不会使用该产品。

此时马斯克的点赞恰逢其时,在舆论场上,OpenClaw创始人的质疑与马斯克的认可形成鲜明对比。对于正在融资的月之暗面而言,马斯克的认可无疑极具分量,尽管不能过度解读其一条推文,但这一表态还是让更多人开始关注这篇论文,一个十一年未被触动的组件被重新审视,后续发展值得期待。