大型语言模型在深度扩展过程中面临的信息衰减问题,一直是制约其性能提升的关键瓶颈。华中科技大学电子信息与通信学院与字节跳动Seed团队联合攻关,提出深度混合注意力机制(MoDA),通过创新的信息传递方式显著提升了模型处理复杂任务的能力。该研究成果已发表于arXiv平台,论文编号为arXiv:2603.15619v1。

传统模型在增加网络层数时,早期输入的关键信息会因反复压缩而逐渐丢失,就像传话游戏中原始信息在多次传递后失真。现有解决方案存在明显局限:残差连接虽能缓解梯度消失问题,但会将历史信息压缩为单一线索,导致重要特征被稀释;密集连接虽能完整保留历史信息,却因计算复杂度随层数平方增长而难以应用于大型模型。

研究团队提出的MoDA机制突破了传统框架,通过将序列注意力与深度注意力融合到统一计算空间,使每个注意力头既能处理当前层信息,又能自适应检索历史层的关键特征。这种设计相当于为模型配备智能记忆系统,在保持计算效率的同时实现跨层信息的高效利用。实验数据显示,在1.5B参数规模的模型中,MoDA使下游任务平均性能提升2.11%,而计算开销仅增加3.7%。

技术实现层面,MoDA构建了扩展的键值序列结构,将当前层信息与历史深度信息联合处理。通过掩码机制确保因果性约束,使每个查询只能访问对应的历史深度信息。在写入阶段,模型采用轻量级键值投影技术,将前馈网络层的信息也纳入深度流,形成包含多类型信息的完整记忆库。这种设计既保证了信息完整性,又将参数复杂度控制在线性增长范围。

针对硬件部署挑战,研究团队开发了系列优化算法。通过Flash兼容的深度键值布局,将内存访问模式优化为连续块操作,使64K序列长度下的处理效率达到FlashAttention-2的97.3%。进一步提出的块感知布局和组感知计算策略,通过局部深度键值访问和共享基时间索引技术,将有效深度利用率提升至理论极限的80%以上。这些创新使MoDA在保持理论优势的同时,具备了实际工程应用的可能性。

实验验证表明,MoDA在不同规模模型中均表现出稳定性能提升。在700M参数模型上,训练困惑度降低0.41,下游任务性能提升1.17%;1.5B参数模型在10个基准测试中平均困惑度下降0.2。注意力可视化分析显示,模型确实在跨层深度信息上分配了显著注意力权重,特别是中间层和后期层表现出持续的历史信息检索行为。这种机制使模型能够同时处理局部序列依赖和全局深度关系,形成更复杂的信息处理模式。

研究团队还探索了深度键值状态的有界缓存技术,通过固定大小的深度键值槽缓冲区,动态管理历史信息存储。这种设计将内存开销从深度依赖转为槽位依赖,为超大规模模型训练提供了可行方案。初步实验显示,在48层模型中,后归一化配置从深度键值中获得的收益比预归一化配置大10倍,表明该技术特别适用于深层网络优化。

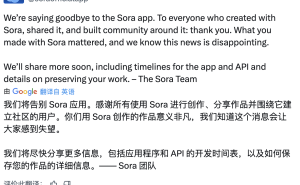

目前,研究团队已开源完整实现代码,包括朴素实现版本和经过多重优化的高效版本。这些代码为开发者提供了从基础验证到工业部署的完整工具链,特别是硬件感知优化策略,可直接应用于现有AI基础设施的升级改造。随着CUDA工程优化的持续推进,MoDA有望成为下一代大型语言模型的核心组件之一。