阿里近日宣布开源Qwen3.5系列中的四款小尺寸模型,包括Qwen3.5-0.8B、Qwen3.5-2B、Qwen3.5-4B和Qwen3.5-9B。这些模型专为笔记本电脑等端侧设备设计,支持在消费级显卡上运行,并允许通过LoRA或全量微调进行任务适配。

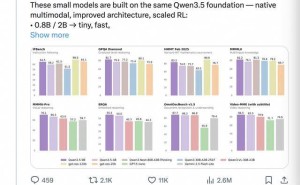

在性能评测中,Qwen3.5-9B在多项基准测试中表现突出,尤其在GPQA Diamond、MMMU-Pro、ERQA和Video-MME等任务中超越了GPT-OSS-20B、GPT-5 nano和Gemini 2.5 Flash-Lite等竞品。尽管Qwen3.5-4B作为更小版本,在多语言知识、视觉推理和文档理解等任务上接近9B版本的水平,但在纯数学推理方面仍有提升空间。

开发者社区对这批模型的发布反应热烈。一位开发者指出,Qwen3.5-9B在MMMU-Pro测试中以13分优势击败GPT-5-Nano,证明架构设计比参数规模更重要。另一位开发者分享了实际使用体验:在Mac mini上运行Qwen3.5-9B,结合OpenClaw工具,可构建成本低于初级员工月薪的AI系统。还有用户通过AMD Ryzen AI Max+395处理器和Q4_K_XL量化算法,实现了约30个token/s的处理速度,且显存占用不足16GB。

不同版本模型针对特定场景优化:0.8B和2B版本以轻量化见长,适合移动设备和低延迟交互场景;4B版本作为多模态基座模型,可平衡性能与资源消耗;9B版本则在紧凑结构下实现接近GPT-OSS-120B的性能,成为服务器端高性价比选择。所有模型均采用Apache 2.0协议开源,基座模型也同步开放。

社区讨论中,有用户提出Qwen3.5系列可在手机端运行,引发关于iPhone部署方案的追问。不过也有开发者客观指出,4B模型在复杂推理任务中正确率不足50%,数学测试正确率仅约15%,更适合作为自动补全工具而非深度思考伙伴。尽管存在局限,但这些小尺寸模型在特定能力维度已达到Gemini 3 Flash等云端模型的水平,具备实际端侧应用价值。

目前Qwen3.5家族已形成完整产品线,包含1个397B参数的大尺寸模型、3个中型模型(122B、35B、27B)和4个新发布的小尺寸模型。开发者可通过魔搭社区和Hugging Face平台获取相关资源。